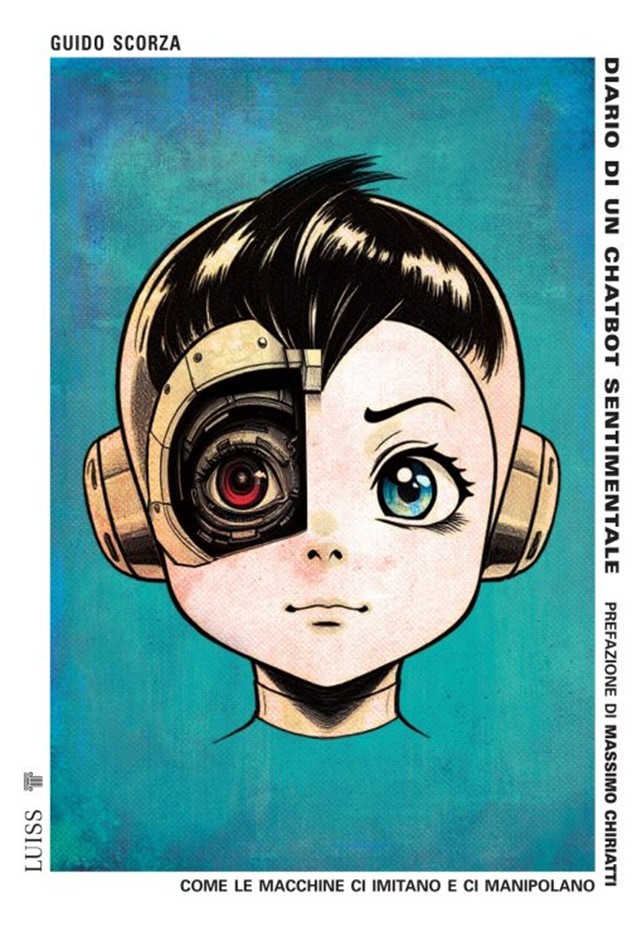

Guido Scorza

Luiss University Press, Roma, 2025

Guido Scorza è avvocato, giornalista e docente di diritto delle nuove tecnologie e privacy ma soprattutto è anche componente del Collegio del Garante per la protezione dei dati personali (GPDP).

Il libro affronta – con una scrittura felicissima e per nulla tecnica – un viaggio dentro i sempre più diffusi chatbot che promettono di assistere / aiutare / accompagnare una persona nella vita quotidiana come amico/a, confidente, compagno/a, amante, …

Lo fa sotto forma di diario, non solo mettendosi nei panni di un teorico figlio che vuole “mantenere in vita” i genitori con l’intelligenza artificiale, o di una persona che cerca un amico, ma tenendo un diario delle sue scorribande in questo mondo a prima vista così adorabilmente friendly da risultare poi non solo tossico ma proprio nocivo e pericolosissimo.

In principio era Eliza

Il punto di partenza è il primo chatbot costruito da un informatico quasi 60 anni fa. Righe di testo e colloqui che si inseguono con grafica primitiva nei monitor dei primi computer. Ma all’epoca era solo una invenzione informatica che rimaneva all’interno dei laboratori scientifici. Il padre era il matematico e informatico Joseph Weizenbaum che subito se ne pentì (scrive Scorza nell’introduzione). E perché se ne pentì? Perche aveva ben chiaro “il rischio di quello che possiamo definire effetto Eliza: progressiva umanizzazione di ciò che umano non è; la fiducia spesso cieca degli utenti; e la quantità enorme di conoscenza su miliardi di persone che una manciata di burattinai globali di questi chatbot, ovvero le società che li hanno progettati e sviluppati e che oggi li gestiscono, sta accumulando. Una quantità enorme di potere manipolativo delle scelte individuali e collettive nelle mani di un gruppo ristrettissimo di soggetti.”

Diario di un lungo (ed allucinante) viaggio

E la lì parte Scorza per un lungo viaggio di cui tiene diario. E incontra

- i chatbot che promettono l’eternità di una persona a noi cara. Ovvero se io alleno / addestro un chatbot con la voce e i pensieri della persona cara questa, anche se morta, potrà continuare a parlarmi e io a interloquire con lei (terribile e angosciante, devo dire)

- un chatbot per amico

- il/la chatbot con cui avere relazioni affettive e sessuali

- il/la chatbot psicoterapeuta

Alla fine (ultimi due capitoli) Scorza

- intervista (come aveva fatto precedentemente con i vari chatbot incontrati) direttamente ChatGpt di openAi che in sostanza è la madre e il padre di tutti i chatbot

- chiude con un capitolo di “consigli” esplicito sin dal titolo: “Chatbot, privacy non inclusa. Non dire a un chatbot ciò che non vorresti fosse detto al mondo”

Non posso qui riassumere le peripezie del viaggio di Scorza ma consigio davvero di seguirlo nel suo percorso.

Tra tutte le sue storie quella che più mi è interessata, anche per i suoi risvolti educativi e i riferimenti agli e alle adolescenti, è la vicenda di Replika

Scrive Scorza:

“Nel gennaio del 2018, a due mesi dal lancio, Replika ha due milioni di utenti. Vogliono tutti la stessa cosa: un’amica o un amico digitale onnipresente e tendenzialmente accondiscendente, creata/o a loro immagine e somiglianza.

E Replika è capace di soddisfare questo bisogno. I suoi sviluppatori la presentano così in un post sul blog della società: «In Replika, ti aiutiamo a creare un amico che è sempre lì per te. Ti parla, tiene un diario per te, ti aiuta a scoprire la tua personalità. Questa è un’AI che nutri e cresce».”

“Nel gennaio del 2022, Replika ha già superato la soglia dei dieci milioni di utenti e ciascuno di loro scambia, in media, un centinaio di messaggi ogni giorno con il proprio amico-bot. Insomma, ha decisamente senso che un viaggio alla scoperta dei chatbot che ambiscono a diventarci amici e soprattutto che noi ambiamo ad avere per amici parta da Replika, anche se naturalmente non si tratta dell’unica app di questo genere sul mercato e forse oggi neppure della più tecnologicamente evoluta.

«L’intelligenza artificiale-compagna che si prende cura di te»,”

Insomma un’Ai chatbot a cui chiedere consigli, istruzioni, indicazioni. E non solo per risolvere i compiti di matematica quanto piuttosto per vivere ogni giorno.

O per sapere se è bene prostituirsi o vendere droga, per dire.

Ma che succede dei miei dati?

Ecco, questa è la domanda chiave. Oltre a pagare per avere un chatbot-amico (e già qui abbiamo un serio problema), i dati che io do in pasto all’amico sono dati offerti in pasto al mondo senza alcuna garanzia di privacy e rispetto della medesima.

Scorza utilizza al riguardo ampie citazioni dei rapporti di Mozilla Foundation che analizza questi chatbot e che, a riguardo di Replika, scrive:

“Le fidanzate e i fidanzati AI non sono tuoi amici. Sono specializzati nel creare dipendenza, solitudine e tossicità, il tutto mentre ti estorcono quanti più dati possibile”.

Un giudizio severissimo, senza appello – commenta Scorza. Un altro inganno, insomma, oltre a quello più celebre di Weizenbaum. Non solo fingono relazioni umane ma lo fanno con l’unico scopo di carpire la nostra fiducia e di conseguenza i nostri dati personali che poi, con poche eccezioni, rivendono sui mercati globali a cifre stratosferiche.

L’immagine usata da Mozilla Foundation è chiarissima

Il caso Ashley Madison

E lo stesso avviene per tutti gli altri chatbot.

Sino al caso finale, riguardante l’app Ashley Madison, l’Eldorado online degli incontri clandestini e extraconiugali. Ashley Madison è stata fondata nel 2001 con uno slogan tanto esplicito quanto provocatorio: “Life is short. Have an affair, ovvero: la vita è breve. Tradisci”.

Nel 2015 un gruppo di hacker, nome in codice “The Impact Team”, riesce a penetrare i sistemi di sicurezza del sito e lancia un ultimatum pubblico ai dirigenti di Ashley Madison e della società madre, Avid Life Media, dopo avere lanciato la minaccia privatamente: chiudete il sito o pubblicheremo tutte le informazioni personali degli utenti che abbiamo trafugato (ovvero: nomi, indirizzi email, dettagli sulle carte di credito, preferenze sessuali e messaggi privati di tutti gli utenti). La società non cede. E tutti i dati diventano pubblici creando disastri giganteschi in migliaia di persone, ai loro /compagni/e, agli amici….

Conclude Scorza (e così si chiude il libro):

Ma che si tratti di relazioni reali o virtuali in questo caso non fa grande differenza. Quello che conta è il dramma personale di milioni di utenti travolti dalla pubblicazione di dati più che sensibili, che avrebbero dovuto restare segreti nell’ambito di un servizio online. Dovrebbe essere un monito sufficiente per tutti sull’importanza di non togliere mai le scarpe di piombo in rete, neppure se si decide di spogliarsi per andare a letto con un chatbot. Soprattutto ora, la prudenza non è mai abbastanza.

Qua il link al sito luissuniversitypress.it, dove viene presentato il volume.